在今年拉斯维加斯國際消費電子展(CES 2026) 舞台上,輝達(Nvidia)創辦人黃仁勳沒有 展示一顆新的遊戲顯卡,也沒有發布更快的數據中心晶片,而是講述了一個更具野心的故事:如 何讓汽車學會「思考」。随着「物理AI的ChatGPT 時刻」到來,輝達讓機器不僅能「看見」路,更能 「理解」路上瞬息萬變的世界。

從「反射神經」步向「大腦皮層」

傳統的自動駕駛系統,運作原理更像一套複雜的「反射神經」。它透過鏡頭和感測器(感知)識別出車輛、行人、車道線,再交由另一套演算法決定加速、煞車、轉向。這套系統在標準路況下表現優異,但面對從未見過的突發罕見的場景時,就可能瞬間失靈,因為它缺乏把「所見」與「所為」 聯繫起來的因果推理能力。

輝達此次發布的Alpamayo 模型,核心突破在於為汽車裝上了類似人類的「思維謎」(Chain-of-Thought),那是一種「視覺—語言一動作」 推理模型,能像人類一樣,對複雜場景進行逐步推演。例如當系統看見前方道路散落若不明物體時,其理解與推理過程會是:這可能是掉落貨物。或故障車輛的一部分,它會阻礙車道,後方車輛可能因此緊急閃避,所以我需要減速、開啟警示燈·並在安全時變換車道:最終,系統輸出平順的減速與轉向軌跡。

這個把感知、推理、決策整合為「端到端」 一體的過程,正是黄仁勳所说的「物理』的 ChatGPT 時刻」,機器開始理解物理世界的邏輯,並據此推理和行動。

開源工具讓車廠訓練

理達的戰略透不止於打造一個聰明的AI模型,更在於構建一個完整的生態系統。首先,是開源核心「教材」。輝達把包含約100倍參數的基礎模型「Alpamayo」免費公開在Hugging Face等平台上,車廠可以利用這個「大腦」作為基礎,導入自己的行車數據進行「特訓」,培養出適應自家車型與地區路況的專屬模型。

其次是提供頂級「駕校」,開源仿真工具 AlpaSim,開發者可在這個高度逼真的虛擬世界中,創造無數極端或危險的罕見路況,讓AI「學員」 進行千萬次的安全試錯與練習,大幅降低實車測試的風險與成本。

最後,是組建產業「聯盟」。這套開源工具已獲得包括 Lucid、捷豹路虎、Uber 等車企與出行服務商的支持。它們計劃基於此開發L4級自動駕駛技術,這意味輝達正從晶片供應商,轉型為定载「駕駛教學體系」與「交通規則」的產業生態。

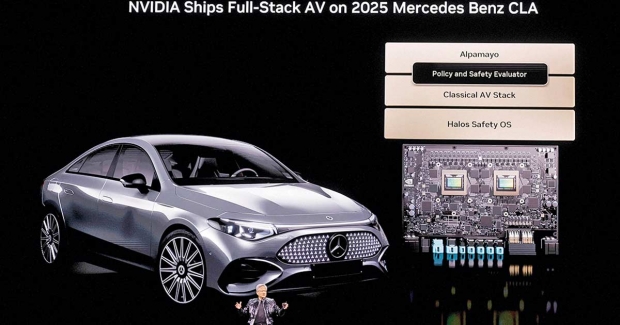

把安全攸關的行為交給AI,最大的疑慮在於其「黑盒子」特性與不可預測性。輝達為此設計了一套「雙重大腦」安全架構,其中Alpamayo 創新堆疊負責處理複雜、動態的駕駛場景,進行類人推理;而辉達 Halos 經典安全堆疊則是一套基於確定性規則、行為可追溯的傳統安全系統,如同永不疲勞的安全員。

兩套系統並行運作,在絕大多數情況下,由創新的AI系統主導流暢駕駛:一旦AI的決策表現出不確定性或超出安全邊界,系統會在毫秒內無縫切換至經典安全系統,確保車輛絕對安全。這設計旨在用技術構建人與機器之間的終極信任。

這場變革的早期成果已經落地。首款搭載理達DRIVE平台及其核心由 Alpamayo等模型驅動的Mercedes Benz CLA車型已正式亮相,相關的 AI駕駛功能年內將在美國推出。同時,輝速官宣了L4級自動駕駛計程車的測試計劃。

讓AI走出數據中心

黃仁勳預言,未來10年世界上很大一部分汽車將具備高度自動駕駛能力,當汽車不再只是聽從指令的機械,而是能夠觀察、思考並解釋決策的夥伴,我們的出行方式、城市規劃,以至人與機器的關係,都將被重新定義。這不僅是技術的选代·更是一場認知的遷徙。

辉速在CES 2026展示的是讓AI走出數據中心,擁有理解物理世界常識的能力。

原文請按這裡

曾啟邦 (Rex)

作者為 AlgoBot聯合創辦人